در سالهای اخیر، هوش مصنوعی جایگاه ویژهای در گفتگوهای علمی، صنعتی و حتی عمومی پیدا کرده است. با ظهور مدلهای پیچیدهتر و پیشرفتهتر، ادعاهای متفاوتی دربارهی قابلیتها و محدودیتهای این فناوری مطرح میشود. یکی از این ادعاها بهتازگی توسط داریو آمودی، مدیرعامل شرکت انتروپیک، مطرح شد که معتقد است مدلهای هوش مصنوعی امروزی کمتر از انسانها دچار توهم یا هذیانگویی میشوند. اما آیا این ادعا قابلپذیرش است؟ این مقاله به بررسی این موضوع، همراه با تحلیل دیدگاههای موافق و مخالف و همچنین مرور پیشرفتهای اخیر در حوزه هوش مصنوعی میپردازد.

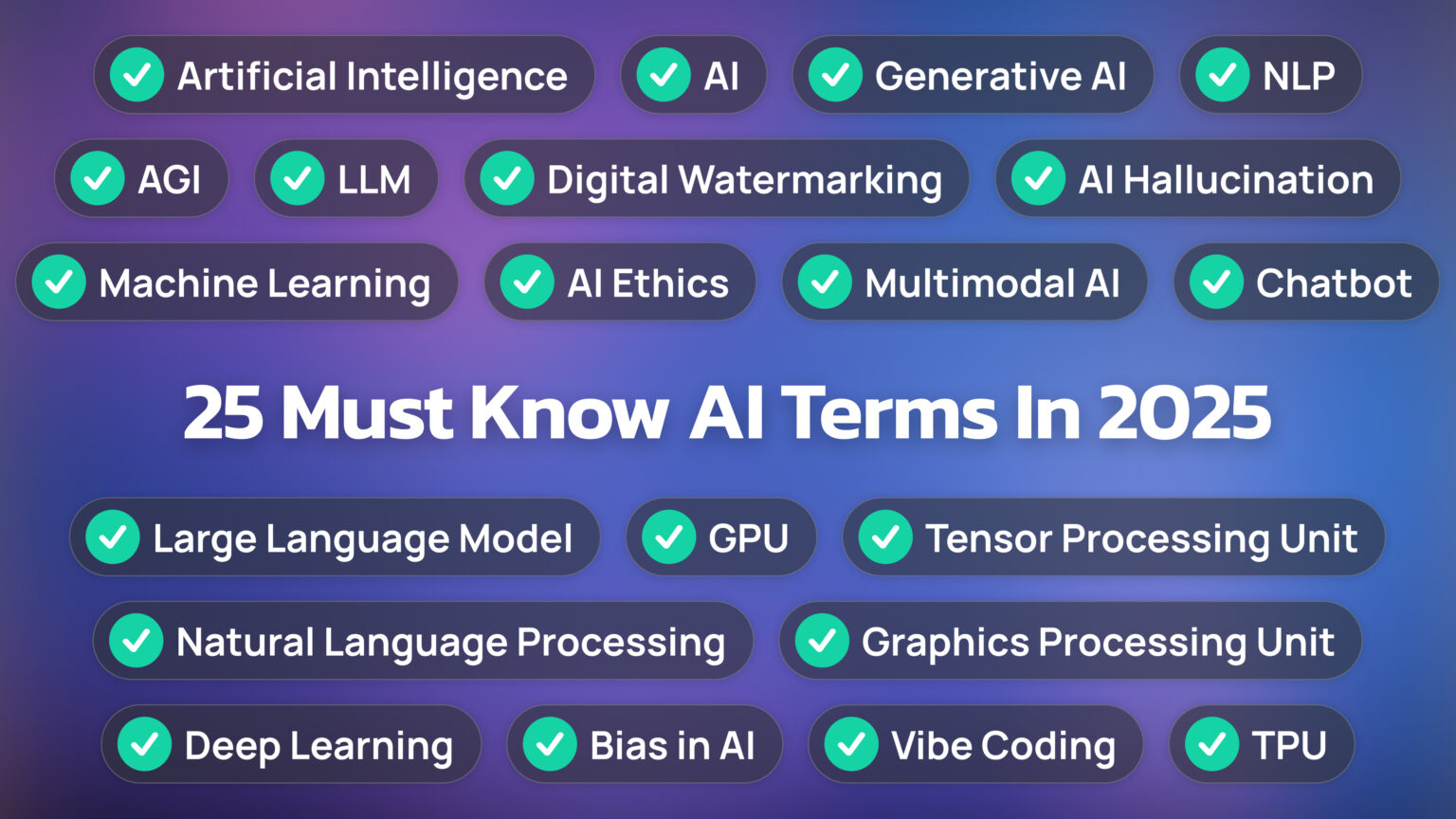

توهم در هوش مصنوعی: یک تعریف مفهومی

توهم در هوش مصنوعی (Hallucination) به زمانی اطلاق میشود که یک مدل هوش مصنوعی اطلاعاتی نادرست را با اطمینان کامل و ظاهراً بهعنوان اطلاعات واقعی ارائه میدهد. این پدیده میتواند در سیستمهای مبتنی بر زبان طبیعی بسیار آشکار باشد؛ چرا که پاسخهایی تولید میکنند که در نگاه اول دقیق و موثق به نظر میرسند، اما در واقع پایهای درستی ندارند.

“مدلهای هوش مصنوعی در مسیر پیشرفت به سطحی رسیدهاند که خطاهایشان کمتر از انسانها است.”

داریو آمودی، مدیرعامل انتروپیک

با این حال، سوال اصلی اینجاست: چگونه میتوان میزان توهم را اندازهگیری کرد و آیا معیارهای موجود برای چنین مقایسهای کافی هستند؟

نقدها و اختلافات: دیدگاههای مخالف در مورد ادعای آمودی

برخی کارشناسان و فعالان حوزه هوش مصنوعی دیدگاه متفاوتی نسبت به ادعای آمودی دارند. دِمیس هاسابیس، مدیرعامل گوگل دیپمایند، اخیراً در اظهار نظری اعلام کرده که مدلهای هوش مصنوعی کنونی هنوز پر از نقص و حفرههای مفهومی هستند. برای مثال، در پروندهای حقوقی اخیر، یکی از مدلهای انتروپیک بهنام Claude اطلاعاتی اشتباه در استنادها تولید کرد که باعث شرمندگی این شرکت شد.

“مدلهای امروزی با وجود پیشرفتهای چشمگیر، هنوز در پاسخ به بسیاری از پرسشهای بدیهی ناکام هستند.”

دِمیس هاسابیس، مدیرعامل گوگل دیپمایند

این اختلافنظرها نشاندهندهی اهمیت ارزیابی دقیقتر عملکرد مدلهای هوش مصنوعی و مقایسه آنها با استانداردهای انسانی است. دادههای اخیر نیز حاکی از آن است که نسلهای جدیدتر هوش مصنوعی مانند GPT-4.5 در برخی موارد نرخ خطاها را کاهش دادهاند، اما در عین حال مشکلات جدیدی ایجاد کردهاند.

راهکارهای کاهش توهم در مدلهای هوش مصنوعی

یکی از راهحلهای پیشنهادی برای کاهش توهم در سیستمهای هوش مصنوعی، فراهمسازی دسترسی مستقیم به منابع معتبر، مانند جستوجوی وب، است. این راهکار میتواند احتمال تولید اطلاعات نادرست توسط مدلها را کاهش دهد. علاوه بر این، تنظیم پارامترهای داخلی مدلها و استفاده از آموزشهای تخصصیتر نیز میتواند به ارتقاء دقت آنها کمک کند.

جالبتر اینکه در برخی دادهها آمده مدلهای قدیمیتر، در برخی آزمونهای خاص، عملکرد بهتری نسبت به نمونههای جدیدتر داشتهاند. چراکه افزایش پیچیدگی مدلها گاهی منجر به افزایش نرخ توهم شده است.

آینده هوش مصنوعی: دستیابی به AGI تا سال ۲۰۲۶؟

دستیابی به هوش مصنوعی انسانگونه (AGI) یکی از آرزوهای بلندمدت صنعت فناوری است که پیشبینیهای مختلفی دربارهی زمان تحقق آن وجود دارد. داریو آمودی در مقالهای که سال گذشته منتشر کرد، پیشبینی کرد که AGI ممکن است تا سال ۲۰۲۶ به واقعیت بپیوندد. اما بسیاری از صاحبنظران این زمانبندی را بیش از حد خوشبینانه میدانند.

آیا واقعاً شاهد تحقق AGI در این زمانبندی خواهیم بود؟ این موضوع هنوز نیازمند پژوهشهای فراوان و پیشرفتهای عمده است. در این بین، همگام با رشد فناوری، سوالات اخلاقی و اجتماعی جدیدی نیز مطرح خواهند شد.

نتیجهگیری نهایی

با توجه به مجموعهای از ادعاها و دادههای موجود، بهنظر میرسد که هیچ پاسخ قطعی دربارهی برتری هوش مصنوعی نسبت به انسان در اجتناب از خطاهای مفهومی وجود ندارد. اگرچه پیشرفتهای انجامشده قابل توجهاند، اما چالشهای بسیاری نیز همچنان وجود دارند که نیازمند بررسی و حل هستند.

از شما دعوت میکنیم تا در بخش نظرات دیدگاههای خود را با ما در میان بگذارید. آیا آیندهای را تصور میکنید که در آن هوش مصنوعی کاملاً بیخطا باشد؟ نظرات شما در این مباحث بسیار ارزشمند است. حتماً نظرتان را ثبت کنید!

دیدگاه ها