در هفتههای اخیر، اخبار مرتبط با عملکرد مدل هوش مصنوعی جدید متا، Maverick، موجی از بحثها را در میان علاقهمندان و کارشناسان هوش مصنوعی ایجاد کرده است. این مدل که از خانواده Llama 4 است، بهعنوان نسخهای مدرن و آزمایشی در دنیای هوش مصنوعی معرفی شد اما به جای تحسین، انتقادهای بسیاری را به خود جلب کرد. در این مقاله به تحلیل عمیق دلایل شکست Maverick در بنچمارکهای مستقل و تأثیر این شکست بر آینده مدلهای هوش مصنوعی میپردازیم.

بنچمارک LM Arena و نقش آن در سوقدادن متا به انتقادات

یکی از برجستهترین دلایل شکست Maverick، استفاده متا از نسخهای آزمایشی و منتشرنشده برای کسب نتایج بالاتر در بنچمارک LM Arena بود. LM Arena پلتفرمی است که در آن عملکرد مدلهای هوش مصنوعی با مقایسه پاسخهای آنها توسط داوران انسانی سنجیده میشود. مشخص شد که متا از نسخه “Llama-4-Maverick-03-26-Experimental” استفاده کرده است؛ مدلی که برای مکالمه بهینهسازی شده بود و نه عملکرد عمومی.

به همین دلیل، پس از افشای این موضوع، LM Arena سیاستهای امتیازدهی خود را تغییر داد و تصمیم گرفت تنها مدلهای رسمی و دستنخورده در رتبهبندیها ارزیابی شوند. این اقدام باعث آسیب جدی به اعتبار متا شد و حتی کاربران و کارشناسان مستقل از این عمل بهعنوان “فریب پلتفرم” یاد کردند.

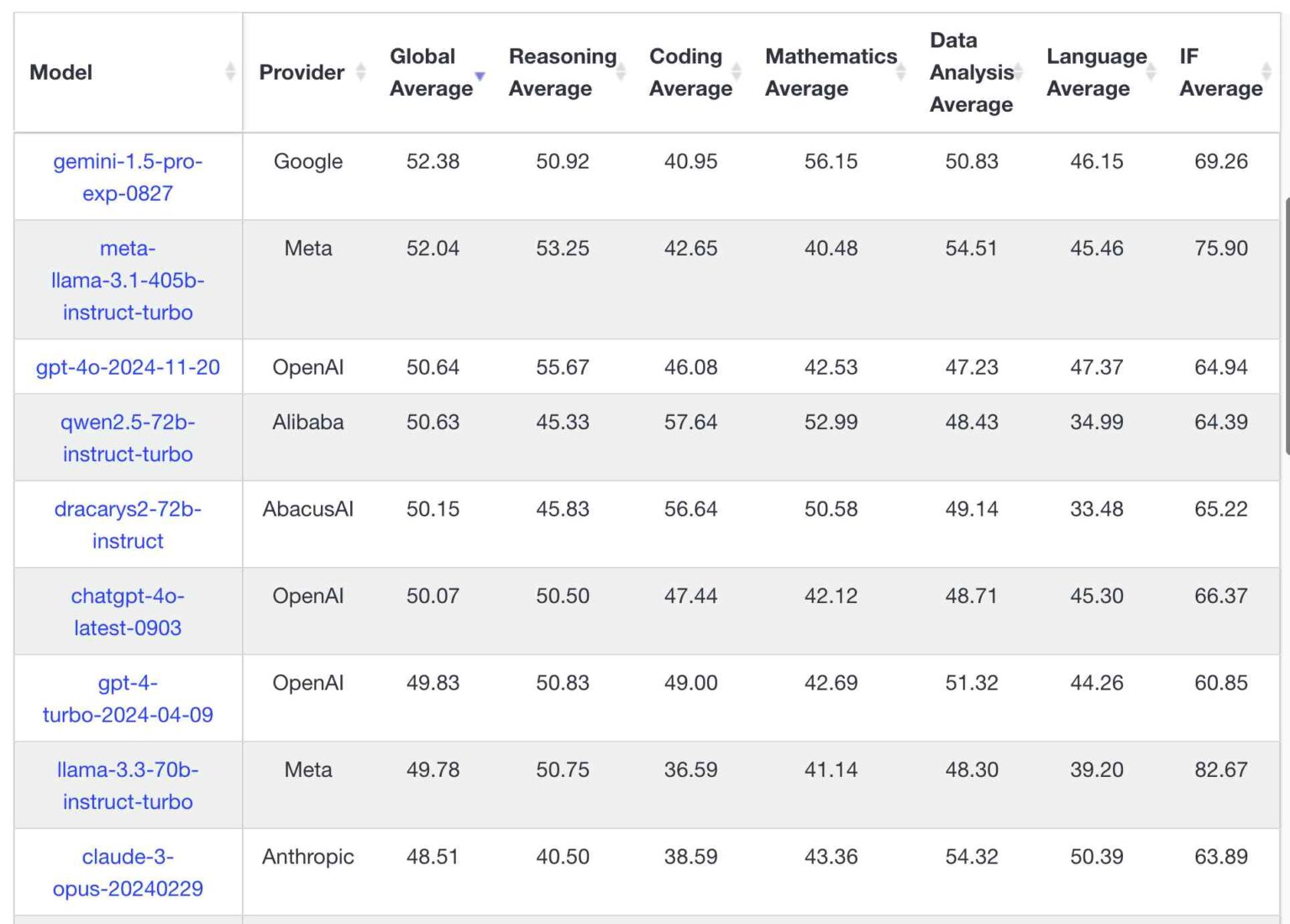

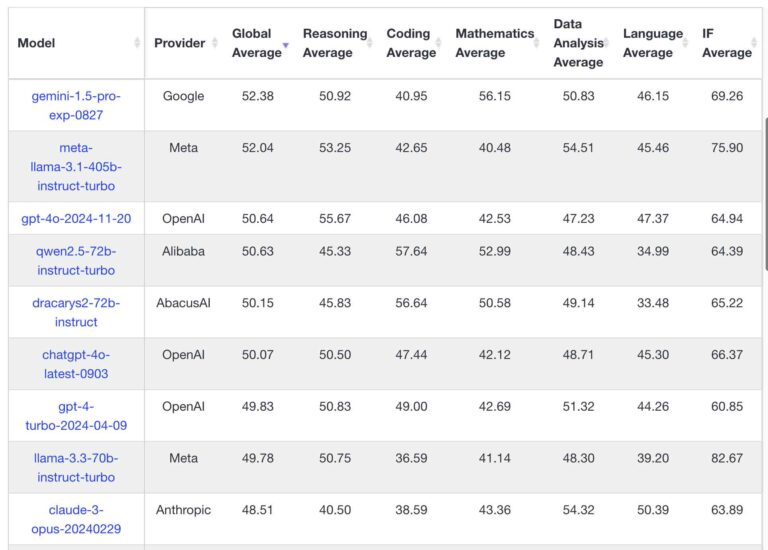

عملکرد ضعیف Maverick در مقابل رقبا

در بررسیهای مقایسهای، مدل رسمی Maverick که با نام کامل “Llama-4-Maverick-17B-128E-Instruct” معرفی شده است، نتوانست با مدلهای مطرحی چون GPT-4o، Claude 3.5 Sonnet و Gemini 1.5 Pro رقابت کند. جالب این است که این مدلها مدتها پیش معرفی شدهاند و از نظر قابلیتها بهینهتر عمل کردهاند. این موضوع نشان داد که Maverick نه تنها نیاز به پیشرفت فنی بیشتری دارد، بلکه در استراتژی بازاریابی نیز ضعفهای اساسی وجود دارد.

تأثیر محیط آزمایشی بر کارایی

یکی از جذابترین مباحث درباره Maverick، بهینهسازی این مدل برای محیطهای خاص بود. نسخه آزمایشی این مدل توانسته بود در محیط LM Arena عملکرد بسیار خوبی ارائه دهد، زیرا برای جلب نظر داوران انسانی طراحی شده بود. اما آیا چنین مدلی واقعاً میتواند در کاربرهای عمومی موفق باشد؟

بهینهسازی بیش از حد برای یک پلتفرم خاص معمولاً عملکرد کلی مدل را کاهش میدهد. چنین رویکردی از سوی توسعهدهندگان ممکن است باعث گیجشدن کاربران در درک کارایی واقعی مدل شود و همچنین اعتبار شرکت را در بلندمدت تحت فشار قرار دهد.

چالشهای اعتمادسازی در هوش مصنوعی

یکی از پیامدهای شکست Maverick، طرح سوالاتی جدی درباره اعتماد عمومی به هوش مصنوعی است. کاربران بهدنبال مدلهایی هستند که در محیطهای واقعی و متنوع بتوانند عملکرد بهتر و قابلاعتمادی ارائه دهند. استفاده متا از نسخههای آزمایشی و بهینهشده برای تحقق اهداف کوتاهمدت، ممکن است اعتماد کاربران و شرکای تجاری را متزلزل کند.

“اعتبار مدلهای هوش مصنوعی تنها از طریق شفافیت و ارائه کارایی واقعی قابل حفظ است.”

– یک تحلیلگر مستقل هوش مصنوعی در حوزه فناوری

نقطه عطفی برای بنچمارکهای آینده

یکی از نکات مثبت این شکست، تغییر سیاستهای بنچمارکهایی مانند LM Arena است. تصمیم این پلتفرم برای ارزیابی فقط مدلهای رسمی، نه تنها قابلیت اعتبارسنجی عملکرد مدلها را افزایش میدهد، بلکه توسعهدهندگان را به ارائه محصولاتی واقعیتر و کارآمدتر ترغیب میکند. چنین قوانینی میتواند معیارهای جدیدی برای قضاوت درباره مدلهای هوش مصنوعی تعریف کند و روند بهبود کلی در این حوزه را تسریع ببخشد.

نگاهی به آینده مدلهای هوش مصنوعی

پیشرفت در هوش مصنوعی بهویژه در مدلهایی مانند بزرگ زبانها (LLMs)، نیازمند شفافیت، مقیاسپذیری، و تلاش برای برقراری تعادل است. اگرچه Maverick متا در آزمونهای اولیه خود شکست خورده است، اما این شکست میتواند فرصتی باشد برای تیمهای توسعهدهنده تا ضعفهای خود را شناسایی کرده و برای ساخت مدلهایی با عملکرد پایدارتر سرمایهگذاری بیشتری کنند.

از سوی دیگر، این تجربه نشان میدهد که کاربران و مشتریان فناوریهای نوین باید همواره محتاط باشند و تنها به نتایج بازاریابی چشمگیر بسنده نکنند.

افکار نهایی

مدل Maverick متا، با همه وعدهها و تبلیغاتی که در ابتدا داشت، نشان داد که تنها برتری در بنچمارکها نمیتواند تضمینی برای موفقیت باشد. شرکتها در حوزه هوش مصنوعی باید با شفافیت و طرح مطالعههای کاربردیتر پیش بروند تا بتوانند اعتماد بیشتری جلب کنند. همچنین این شکست میتواند به نقطه آغازی برای بازتعریف معیارهای ارزیابی مدلهای هوش مصنوعی تبدیل شود.

حال نوبت شماست! چه دیدگاهی درباره این اتفاق دارید؟ آیا چنین شکستهایی را قدمی برای پیشرفت میدانید یا نوعی ضعف در مدیریت کلی میپندارید؟ نظرات خود را در بخش کامنتها با ما به اشتراک بگذارید.

دیدگاه ها