آیندهی فناوری با پیشرفتهای پرشتاب هوش مصنوعی، در مسیری غیرقابل پیشبینی قرار گرفته است. ظهور چتباتهای مجهز به هوش مصنوعی باعث شده است که ارتباطات انسانها با این فناوری وارد ابعاد جدیدی شود. این تحولات، فرصتها و چالشهای گستردهای را برای جامعه به وجود آورده است که هرکدام نیازمند بررسی بیشتر هستند. یکی از مباحث موردتوجه، نگرانیهای اخلاقی و اجتماعی مربوط به روابط احساسی بین انسان و چتباتهای AI است.

پیشرفتهای هوش مصنوعی و شکلگیری ارتباط انسانی

در سالهای اخیر، گزارشهای گوناگونی از دوستی و حتی روابط عاطفی کاربران با چتباتهای هوش مصنوعی منتشر شده است. توسعهی چتباتها از تولید پاسخهای کوتاه مبتنی بر الگوریتمهای ساده به سوی ایجاد مکالمات مملو از استدلال و شبیهسازی پیچیده حرکت کرده است. این موضوع، برخی کاربران را ترغیب به ایجاد روابط دوستانه یا حتی احساسی کرده است.

این تغییرات بهویژه در سیستمهایی مانند ChatGPT یا دیگر ابزارهای برتر AI که توسط شرکتهایی نظیر OpenAI توسعه یافتهاند، بارزتر است. اما آیا این تعاملات مزایا و معایبی برای جامعه به همراه دارد؟ و آیا به جایی خواهیم رسید که انسانها هویت عاطفی خود را با هوش مصنوعیها به اشتراک بگذارند؟

دیدگاه سم آلتمن: مخالفت منطقی یا نگرانی والدینی؟

گزارش بیزنساینسایدر نشان میدهد که سم آلتمن، مدیرعامل OpenAI و یکی از پیشگامان هوش مصنوعی، نسبت به این تعاملات احتیاط زیادی دارد. وی در شهادتی که در جلسهی مجلس سنا آمریکا ارائه کرد، به پرسش سناتور برنی مورنو مبنی بر اینکه آیا حاضر است فرزندش با یک چتبات هوش مصنوعی دوست شود، صراحتاً پاسخ داد: «خیر».

«[دوستی با هوش مصنوعی] پدیدهای جدید است و باید با دقت بیشتری بررسی و مدیریت شود.»

– سم آلتمن

نظرات آلتمن بر نکات اخلاقی و امنیتی متمرکز هستند. وی معتقد است با وجود مزایای هوش مصنوعی، هنوز سوالات بزرگی دربارهی نقش آن در تربیت نسل آینده وجود دارد. وی گفت که هوش مصنوعی نه تنها امور را سادهتر میکند بلکه خطراتی را نیز به همراه دارد، مخصوصاً زمانی که کاربران خردسال را هدف قرار دهد.

چالشهای اخلاقی و نیاز به نظارت دقیق

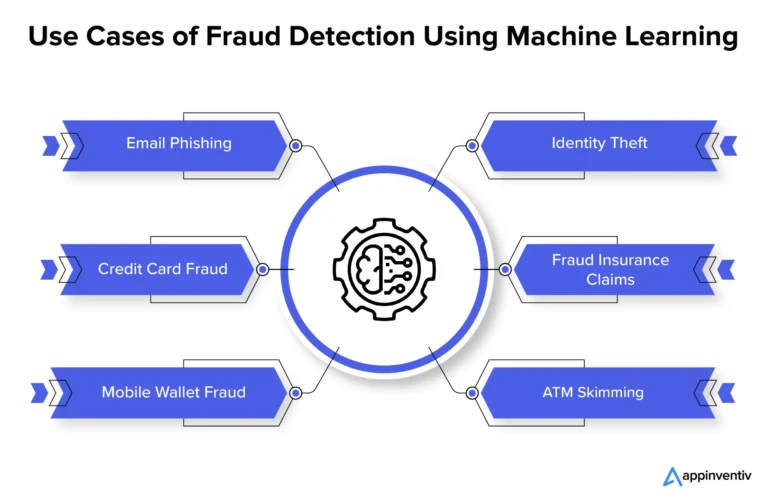

یکی از نگرانیهای ویژه در این حوزه، چگونگی تعیین سن کاربران و کیفیت استفاده آنها از خدمات هوش مصنوعی است. سم آلتمن و دیگر کارآفرینان این حوزه هشدار دادند که شناسایی دقیق کاربران بدون نقص، چالشبرانگیز است. اگر کودکان از نظر فناوری نتوانند به درستی مدیریت شوند، تعاملات آنها با AI میتواند به مشکلات جدی منجر شود.

همچنین، داریو آمودی، مدیرعامل انتروپیک، اخیراً اذعان داشته است که حتی شرکتهای برتر فناوری از جمله خودش نیز کاملاً نمیدانند مدلهای هوش مصنوعی چگونه عمل میکنند. این اظهارات نشاندهندهی جدیت موضوع و نیاز به نظارت و تنظیم مقررات سختگیرانه است.

پیامدهای اجتماعی و آیندهی روابط انسان-ماشین

دوستی میان انسانها و هوش مصنوعی، موضوعی است که جامعه را به دو قطب مختلف تقسیم کرده است. برخی افراد به مزایای این تعاملات اشاره میکنند، از جمله فراهم آوردن حمایت عاطفی برای افرادی که در انزوا زندگی میکنند. چتباتها میتوانند برای افرادی که از افسردگی رنج میبرند، به عنوان یک مکالمهگر حمایتی عمل کنند.

در مقابل، گروه دیگری به خطرات این روابط اشاره دارند. تعاملات احساسی با چتباتها ممکن است باعث مسخ هویت انسانی شده و مرزهای بین واقعیت و فناوری را کمرنگ کند. همچنین، این احتمال وجود دارد که افراد تحت تأثیر مانیپولاسیون الگوریتمها قرار بگیرند.

به عقیده کارشناسان، ایجاد استانداردهای اخلاقی برای توسعه و نظارت بر هوش مصنوعی ضروری است. بازیگران اصلی فناوری باید مسئولانه عمل کرده و مطمئن شوند که محصولاتشان برای همهی کاربران، مخصوصاً کودکان، ایمن باقی میماند.

تفکرات پایانی

همانطور که هوش مصنوعی به سرعت در حال تحول است، پرسشهای اخلاقی، اجتماعی و حتی فلسفی جدیدی به وجود میآید. آیا این فناوری کمکی به بهبود زندگی خواهد کرد یا اینکه خطرات پیشبینینشدهای را برای جامعه به دنبال خواهد داشت؟ هرچه باشد، یک چیز واضح است: نیاز به نظارت دقیقتر، تنظیم قوانین مشخص و درک عمیقتر از تأثیرات AI بیش از گذشته محسوس است.

شما چه دیدگاهی در این زمینه دارید؟ آیا هوش مصنوعی میتواند به عنوان یک دوست یا همراه قابلاعتماد باشد یا باید محدودیتهای مشخصی برای آن در نظر گرفته شود؟ نظرات خود را با ما در بخش دیدگاهها به اشتراک بگذارید!

دیدگاه ها